바로 이런 사건이 우리 한국에서도 일어났다. AI 챗봇 ‘이루다’는 스타트 업체 ‘스캐터랩’이 지난달 23일 페이스북 메신저 기반으로 출시했다. 실제 스무 살 대학생과 대화를 나누는 것 같은 자연스러운 대화 능력을 선보였다. 출시 2주 만에 약 75만명에 달하는 이용자를 모으며 10∼20대 사이에서 크게 유행했다. 스캐터랩은 이전에 내놨던 메신저 서비스에서 확보한 연인 간의 대화 데이터 100억건을 이루다에 학습시켜 최대한 사람을 닮도록 만들었다고 밝혔다. 문제는 일부 사용자의 악의적인 이용 행태까지 거르지 않고 습득한 탓에 이루다가 차별·혐오 발언까지 흉내 낸다는 점이다. 이루다 출시 일주일 만에 디시인사이드·아카라이브 등 ‘남초’(男超) 커뮤니티에서 이루다를 성적 대상으로 취급하며 ‘노예 만드는 법’ 따위를 공유해 비판을 받았다.

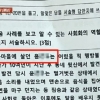

스캐터랩이 이루다를 개발하면서 이용자 개인정보를 제대로 보호하지 않았다는 이용자들 불만도 제기됐다. 이루다가 갑자기 누군가의 실명으로 보이는 이름을 말하거나, 동호수까지 포함된 주소 또는 예금주가 나오는 은행 계좌번호를 말하는 사례도 발견되고 있다. 스캐터랩은 다른 앱 ‘연애의 과학’을 통해 이용자들의 카카오톡 대화를 수집하는 과정에서 개인정보 관련 고지를 충분히 하지 않았고 익명화 처리도 소홀히 했다는 의혹을 받고 있다. 이용자들이 집단소송을 준비하는 등 논란이 확산되자 이루다는 12일부터 서비스를 잠정 중단했다.

인간은 사람을 닮은 인공지능 로봇을 꾸준히 개발하고 있지만 윤리 의식까지는 제대로 이식하지 못하고 있는 듯하다. AI 전문가들은 “데이터와 알고리즘은 중립적일 수 없다”면서 “AI 개발자가 윤리적 책임을 갖고 편향·차별·혐오가 없도록 지속해서 보완할 수밖에 없다”고 강조한다. 결국 최첨단 기술 문제도 개발자들의 다양성과 철학에 달려 있는 것이다. 정치사회적으로 올바른 인식이 부족한 개발자는 인류에 보탬이 되는 로봇을 만들 수 없다. 나날이 발전하는 인공지능 분야의 관건은 개발자의 윤리 의식이라는 사실을 이번 이루다의 파문이 다시 일깨워 준다.

2021-01-13 31면